前不久,Facebook Reality Labs(以下简称FRL)公布了一项结合AR全息衍射技术的VR光学方案,被看作是未来AR与VR技术融合、同时具备两者优势的新品类。

近期,FRL再次公布了一项与旧金山大学伯克利分校共同合作的新研究,论证出一种可以扩大全息显示视场角的方法。

全息显示的优劣分析

在论文《High Resolution Étendue Expansion for Holographic Displays》中提到,全息技术的优势是能够呈现出高质量的3D画面,通过SLM可以产生各个方向的光,能够实现像素级的变焦显示,校正光学系统像差,适用于小型化光学元件。

因此,全息技术也非常适合AR/VR等近眼显示设备。

然而当前的全息显示应用在AR/VR中应用时,动眼框(Eyebox)和视场角(FOV)相互制约,想要获得大的动眼框,就要牺牲视场角大小,反之亦然。

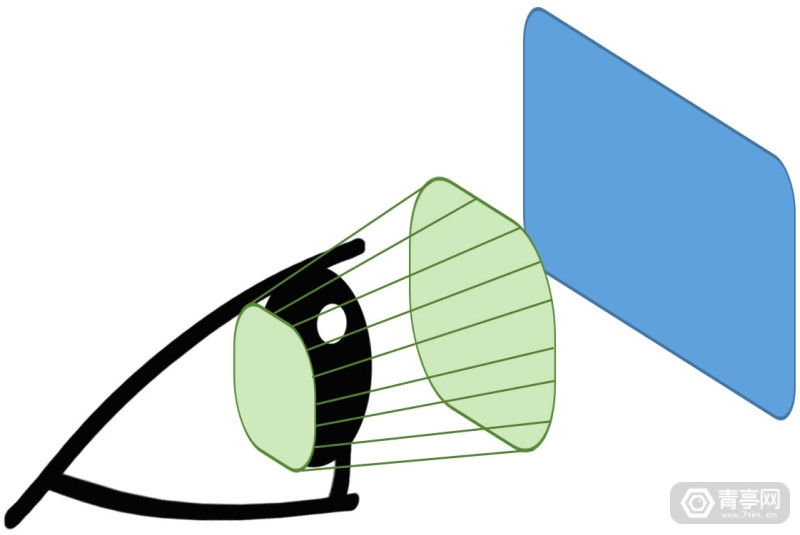

Eyebox示意图

Eyebox是头戴式显示设备中一个非常重要的因素,尤其是在AR设备中,它直接影响着你能够看到虚拟图像的范围大小,直接的说它就决定着你日常佩戴AR眼镜的灵活度,假如Eyebox太小,稍微动一下AR设备你看到的虚拟内容就会不完整,极大降低用户体验。

而FOV也是一个提升视觉体验的重要因素,它直接决定着你能够看到的虚拟图像的画幅大小,FOV越大显示虚拟图像面积越大,沉浸式体验的效果也就越好。然而,在传统非全息光学中获得大视场角并不难,例如Oculus Rift可以直接用大面积显示屏,而在全息显示中由空间光调制器(SLM)所限制。

通常而言,想要获得身临其境的体验FOV要≥90度。

而全息显示器如果将FOV设定在90度,Eyebox则只有1mm多,意味着眼镜稍微晃一下就看不到图像;而暴力解决方案就是增加SLM像素数,在10mm Eyebox时则需要10亿个像素,不过这种方法效率低下,因为所需像素数太大,甚至超越人眼能解析的像素数的2倍。

全息显示扩大视场角新方法

论文指出,通过静态散射掩模来扩大全息显示器视场角则是一个另一个解决方案。

实际上该方法此前已得到应用,但是场景比较简单,例如只有几十个点的风景类内容。因此,为了推进这一方法来解决全息显示视场角问题,必须大幅提升分辨率,以达到现代化的显示水平。

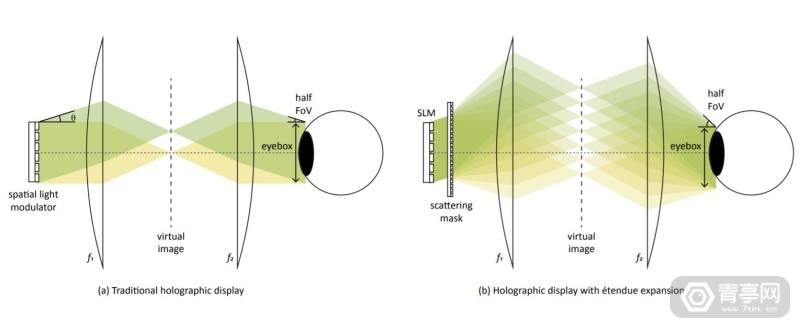

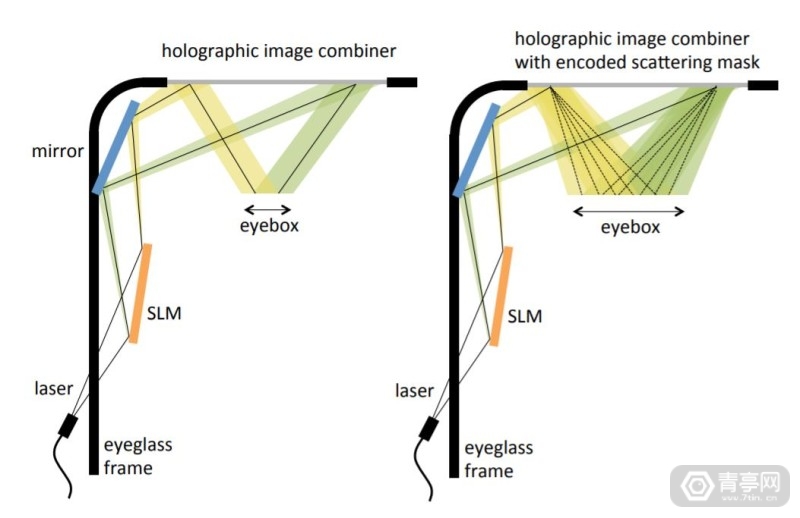

视场角示意图(左:传统光学,右:增加散射掩模层)

简述原理就是,全息显示的波前被掩模散射,自由度比SLM更大,输出的分辨率更高,因此噪点也就更多。而本论文提出的方法关键点在于,全息图像限制在SLM空间频率范围内,从而把噪点控制在人眼无法分辨的更高频率上。

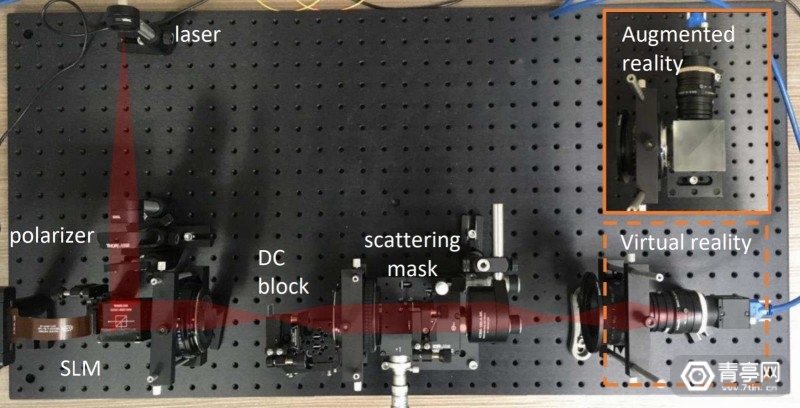

实验用的台式原型机

据悉,该方法可以很好的使用复杂、高分辨率的实拍图,甚至还验证了空间约束下,结合注视点渲染动态分布图像分辨率。同时,Facebook与加州大学伯克利分校设计了框架,来优化这些参数,并在一台原型机上得以验证。

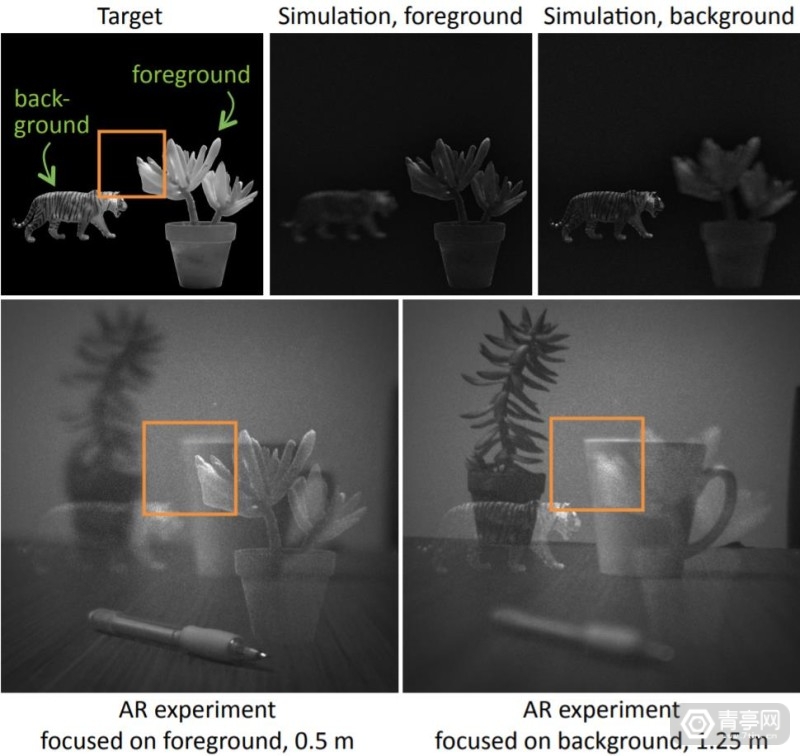

AR原型效果展示:左上角为原图,下方两个为不同深度的图像,橙色框代表扩展前原有FOV大小

同时论文提出目前该方法的一些优势与局限性。

优势:

通过基于约束的散射掩模生成全息图像算法,效果优于此前的技术方案;

通过增加频率和空间约束,显示提高了显示分辨率,实测结果比SLM更好的大视场角高分辨率图像。

未来AR眼镜应用概念示意图:左为基于Maimone等原方法的紧凑全息方案,右为增加散射掩模层,可不牺牲FOV增大Eyebox

劣势:

由于显示设备视场角参数超过SLM原生,因此对比度较低;

计算时间也比此前(论文提到的Buckley et al. 2006; Park et al. 2019; Yu et al. 2017b)方法要长,依然需要优化;

目前原型仅支持单色显示;

该方法对设备准度要求极高,应用到AR、VR中难度较大。

总的来说,虽然实验结果在实际应用中还有待优化与改进,但也让我们看到使用新的SLM技术实现全息显示的新算法有着极大的潜力,尤其是在未来小型化和大众化需求的时代。